Krajem prošle nedelje, OpenAI (tvorci ChatGPT-a, u kojem nam veštačka inteligencija odgovara na pitanja i rešava odredjene zadatke), je najavio novi generativni AI sistem pod nazivom Sora, koji proizvodi kratke video zapise iz tekstualnih upita. Iako Sora još nije dostupna javnosti, visok kvalitet do sada objavljenih uzoraka izazvao je i uzbuđene i zabrinute reakcije.

Svi su bili šokirani prošle godine koliko je ova tehnologija napredovala i to nakon vesti da je umetnost napravljena veštačkom inteligencijom, pobedila na takmičenju ljudske takmičare.

Medjutim je ova tehnologija postala već deo svakodnevnice, ovo nam je i dokaz koliko lako se naviknemo na nešto, što nam je do pre nekoliko godina zvučalo distopijski, svi tehnologški giganti rade na svojim veštačkim inteligencijama, ali OpenAI, je sada ponovo otišao korak dalje, korak koji je zabrinuo mnoge.

On sada radi na nečemu što su nazvali Sora, i ovaj novi model veštačke inteligencije sada omogućava da vi ispišete šta želite, i Sora vam od toga napravi video.

Primeri video snimaka koje je objavio OpenAI i koje možete videti iznad u klipa, za koje kompanija kaže da ih je kreirala direktno Sora bez modifikacija, pokazuju rezultate uputstava kao što su „fotorealističan video snimak iz krupnog plana dva piratska broda koji se bore jedan protiv drugog dok plove u šoljici kafe“ i „istorijski snimak Kalifornije za vreme zlatne groznice“.

Na prvi pogled, često je teško reći da ih generiše veštačka inteligencija, zbog visokog kvaliteta video zapisa, tekstura, dinamike scena, pokreta kamere i dobrog nivoa doslednosti.

Izvršni direktor OpenAI Sem Altman je takođe postavio neke video snimke na platformi X (ranije Tviter) generisane kao odgovor na upite koje su predložili korisnici, kako bi demonstrirao Sorine mogućnosti.

https://t.co/rmk9zI0oqO pic.twitter.com/WanFKOzdIw

— Sam Altman (@sama) February 15, 2024

Sora kombinuje karakteristike alata za generisanje teksta i slike u onome što se naziva „model difuzionog transformatora“.

Transformatori su vrsta neuronske mreže koju je Google prvi put predstavio 2017. Najpoznatiji su po upotrebi u velikim jezičkim modelima kao što su ChatGPT i Google Gemini.

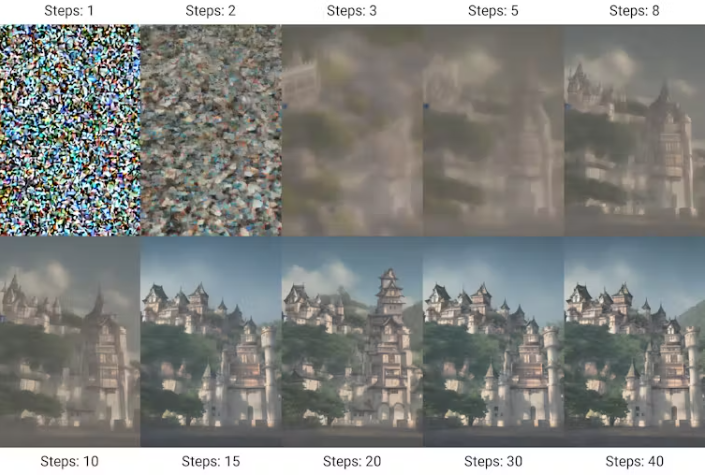

S druge strane, difuzioni modeli su osnova mnogih generatora AI slike. Oni rade tako što počinju sa nasumičnim šumom i ponavljaju se ka „čistoj“ slici koja odgovara upitu za unos.

Od niza takvih slika može se napraviti video. Međutim, u video snimku, koherentnost i doslednost između kadrova su od suštinskog značaja.

Sora nije prvi model za pretvaranje teksta u video. Raniji modeli uključuju Emu od Meta, Gen-2 od Runvai, Stable Video Diffusion od Stabiliti AI, a nedavno i Lumiere od Gugla.

I dalje ovi snimci nisu savršeni, ali opet jezivo je da smo već došli do ovakvih rezultata:

U klipu ispod, Sori je tražen sledeći upit: „džinovska katedrala je potpuno ispunjena mačkama. mačke su svuda gde pogledate. čovek ulazi u katedralu i klanja se pred džinovskim mačjim kraljem koji sedi na prestolu.“

Ovo je veštačka inteligencija napravila:

„a giant cathedral is completely filled with cats. there are cats everywhere you look. a man enters the cathedral and bows before the giant cat king sitting on a throne.“

Video generated by Sora. pic.twitter.com/bkNqCnckUo

— Bill Peebles (@billpeeb) February 17, 2024

Ako je ovo tačno, buduće verzije mogu imati naučne primene za fizičke, hemijske, pa čak i društvene eksperimente. Na primer, neko bi mogao da testira uticaj cunamija različitih veličina na različite vrste infrastrukture – i na fizičko i mentalno zdravlje ljudi u blizini.

ZABRINUTOST

Glavna zabrinutost oko alata kao što je Sora vrti se oko njihovog društvenog i etičkog uticaja. U svetu koji je već opterećen dezinformacijama, alati poput Sore mogu pogoršati stvari.

Lako je videti kako bi se mogućnost stvaranja realističnog videa bilo koje scene koju možete opisati mogla iskoristiti za širenje ubedljivih lažnih vesti ili bacanje sumnje na stvarne snimke. To može da ugrozi mere javnog zdravlja, da se koristi za uticaj na izbore ili čak da optereti pravosudni sistem potencijalnim lažnim dokazima.

Video generatori takođe mogu omogućiti direktne pretnje ciljanim pojedincima, putem deepfakesa – posebno pornografskih. Ovo može imati strašne posledice po živote pogođenih pojedinaca i njihovih porodica.

Takodje kada smo već kod dezinformacija, ova tehnologija će imati potencijal i stvarati lažne snimke iz ratova, lažne ratne zločine, a ujedno i svaki istinski ratni zločin bi bio sumnjiv, upravo zbog postojanja ove tehnologije.

Da ne spominjemo mnoštvo mogućih izgubljenih poslova, jer veštačka inteligencija se sve više traži, jer ne traži platu, radi non stop, i ne mora ići na bolovanje.

Ulazimo u novi svet, pitanje je da li smo spremni i za njegove negativne strane?